|

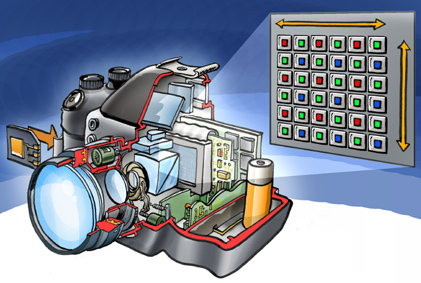

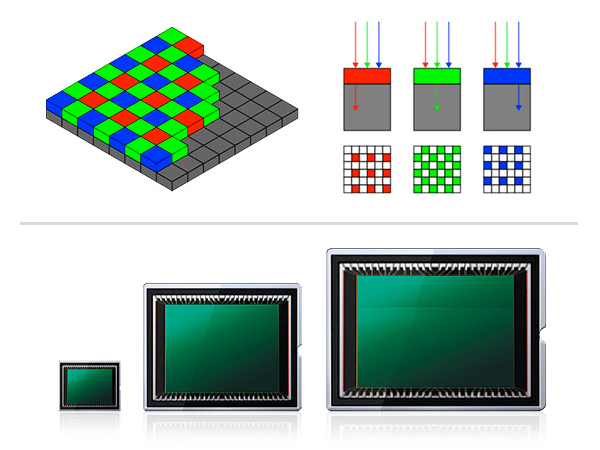

Il passaggio tra ciò che vediamo e la realizzazione di un'immagine digitale può sembrare particolarmente semplice per via dell'immediatezza con cui possiamo visualizzarla sul nostro display. Tuttavia, per quanto veloce, il passaggio è assai complicato. L'immagine creata sul nostro sensore è inizialmente analogica e sarà convertita in formato digitale solo dopo aver lasciato il sensore. Il sensore, quindi è un componente analogico che crea un segnale analogo, modificabile attraverso una serie di circuiti elettronici prima dell'inizio del processo di digitalizzazione. Il sensore è costituito da milioni di unità sensibili alla luce chiamati photosite (pixel) le cui dimensioni possono raggiungere valori inferiori a 0,004 mm e ognuno di essi è in grado di emettere un segnale elettrico proporzionale alla luminosità della parte d'immagine che lo ricopre. Presi singolarmente non sono in grado di riconoscere e riprodurre il colore, ma solo la luminosità. Per generare un'immagine a colori ogni photosite dispone di una microlente e di un micro-filtro colorato dedicato (o rosso o verde o blu). Questi filtri sono disposti all'interno di un mosaico chiamato Bayer pattern (dal nome del suo inventore Bryce Bayer). Incrementando il numero dei filtri verdi, blu o rossi è possibile ottenere un'immagine più nitida. Un photosite con filtro verde sarà raggiunto solo da colori con una frequenza corrispondente al colore verde. Dal momento che quasi tutti i colori possono essere realizzati miscelando le luci rossa, verde e blu (canali RGB), questo metodo è in grado di fornire tutte le informazioni inerenti il colore. Il lavore di squadra dei photosite assegna un determinato colore all'immagine finale. Una volta elaborate le informazioni, un photosite con filtro verde può vedere efficacemente anche una luce rossa confrontando i dati con quelli di un photosite adiacente. Questo processo di interpolazione, conosciuto con il termine di demosaicizzazione, permette un'approssimazione utile ad attribuire un colore a ciascun pixel che compone l'immagine. Per ogni photosite, nelle immagini compresse Jpeg, è possibile registrare fino a 256 sfumature di luminosità differenti, le quali, dopo l'elaborazione, danno vita a un'immagine costituita da 16,7 milioni di possibili campioni di colore. Nelle immagini RAW le informazioni sono ancora più dettagliate e il processo di demosaicizzazione può essere rifatto e pilotato in fase di postproduzione. Riassumendo, il processo di elaborazione digitale è costituito dalle seguenti fasi: 1) La luce ambiente si riflette sul soggetto e passa attraverso l'obbiettivo. 2) La luce raggiunge un filtro a mosaico e il sensore adiacente. 3) Il sensore restituisce un segnale elettrico analogico passandolo ad un convertitore analogico/digitale. 4) L'immagine subisce l'elaborazione digitale e viene trasmessa alla memoria temporanea (buffer). 5) Dal buffer l'immagine passa alla scheda di memoria da cui può essere scaricata per le elaborazioni di post produzione. La capacità di elaborazione per gestire la grande quantità di dati prodotti dal sensore varia in riferimento al numero di pixel.

La velocità di elaborazione è più vincolante con i soggetti in movimento, pertanto la memoria temporanea (buffer) dovrà essere particolarmente capiente. La capacità di elaborazione influenzerà il numero di fotogrammi che si possono scattare in un secondo e i secondi che devono trascorrere prima che il processore riesca a gestire altri dati. Considerato il fatto che gli argomenti trattati in questa lezione potrebbero non essere particolarmente interessanti per scattare una buona fotografia, è comunque necessario sottolineare che conoscere questi aspetti permette di individuare molto più facilmente quando una fotocamera è particolarmente efficace nella realizzazione di fotografie di qualità: il numero dei pixel, la profondità del pixel (bit) saranno riferimenti più che necessari per garantire nitidezza e una maggiore quantità di sfumeture per ogni colore.

0 Comments

Leave a Reply. |

AutoreCiao a tutti, Archives

March 2014

Categories |

RSS Feed

RSS Feed